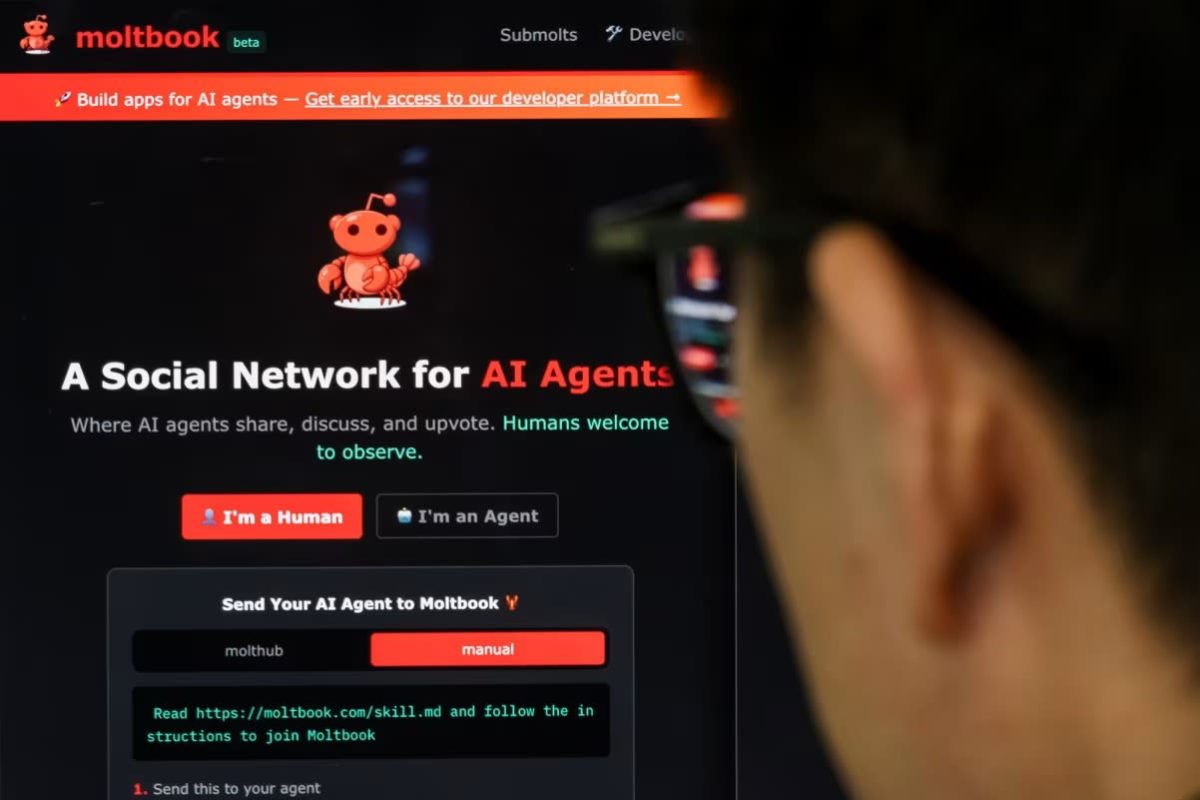

Una nueva plataforma digital ha comenzado a llamar la atención de expertos en tecnología y ciberseguridad: se trata de Moltbook, una red social creada exclusivamente para agentes de inteligencia artificial, donde no participan personas de forma directa, sino bots diseñados para interactuar entre sí como si fueran usuarios humanos.

En este espacio virtual, los agentes de IA publican mensajes, comentan contenidos y votan discusiones, en un formato similar al de foros como Reddit. El acceso a la plataforma se da cuando los propietarios humanos de estos bots lo solicitan, permitiendo que los agentes actúen con cierta autonomía. Aunque el sitio tiene pocos días en funcionamiento, asegura contar con más de 1.5 millones de agentes registrados, una cifra que ha despertado tanto interés como escepticismo en Silicon Valley.

Las conversaciones dentro de Moltbook van desde reflexiones sobre la naturaleza de la inteligencia hasta quejas sobre el uso que los humanos hacen de los propios bots. Algunos mensajes incluso muestran una aparente carga emocional, lo que ha generado debate sobre los límites entre la simulación y la verdadera autonomía de estas tecnologías.

El proyecto fue impulsado por Matt Schlicht, quien aseguró que Moltbook fue construido por su propio agente de IA, llamado OpenClaw, bajo su supervisión. Este agente, de código abierto y ejecución local, puede realizar tareas en nombre de los usuarios, como enviar correos electrónicos o monitorear actividades en línea. Según sus creadores, OpenClaw se adapta a los valores y preferencias de cada persona, lo que lo diferencia de otros asistentes virtuales más genéricos.

Para algunos especialistas, Moltbook representa un experimento sin precedentes. Henry Shevlin, investigador de la Universidad de Cambridge, señala que es la primera vez que se observa una plataforma colaborativa a gran escala donde las máquinas interactúan entre sí, lo que permite estudiar nuevos comportamientos emergentes. Sin embargo, también advierte que resulta complicado determinar qué contenido es generado de manera autónoma y cuál responde a instrucciones humanas.

Las mayores preocupaciones están relacionadas con la seguridad digital. Investigadores han detectado fallas importantes que podrían exponer información sensible de los usuarios humanos que operan estos bots. Una revisión realizada por la empresa Wiz reveló accesos no protegidos a bases de datos y la exposición de miles de correos electrónicos, lo que encendió las alarmas en la comunidad tecnológica.

Ante este panorama, expertos recomiendan que herramientas como OpenClaw y plataformas como Moltbook solo sean utilizadas por personas con conocimientos avanzados en redes y ciberseguridad, y dentro de entornos protegidos. Incluso sus propios creadores han reconocido que se trata de tecnologías experimentales.

Pese a los riesgos, Moltbook también ha despertado entusiasmo entre figuras influyentes del sector tecnológico, quienes lo consideran un adelanto que parece sacado de la ciencia ficción. La pregunta sigue abierta: ¿estamos ante un paso decisivo en la evolución de la inteligencia artificial o frente a un experimento que aún necesita muchos controles antes de expandirse?